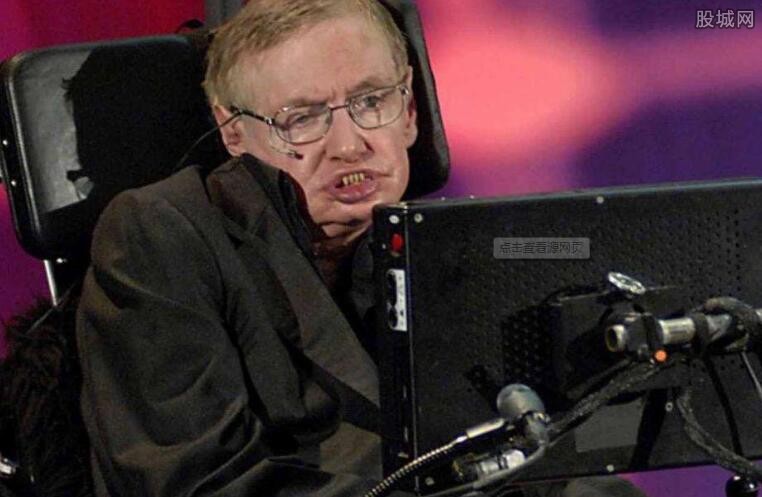

霍金的遗愿清单 内容曝光后网友感到震惊

霍金于3月14日去世了享年76岁,去世之后霍金的遗愿清单也公开了,内容曝光后网友感到十分震惊。

在过去的二十年里,霍金是明星,除了继续探索宇宙理论,他也出现在各种场合,为所有关切人类命运的主题发声。而在他去世前的这几年中,霍金最关注的话题就是:离开地球和警惕人工智能。

现在我们就梳理下霍金通过各种渠道谈论这两个话题的言论。

关于离开地球,早在2011年霍金在接受美国视频共享网站BigThink访谈时就称地球将在两百年内毁灭,人类要想活命只能移民外星球。

2017年11月5日,霍金通过视频指出了人类移民太空的原因所在:一个原因是,对我们来说,地球变得太小了。在过去二百年中,人口增长率是指数级的,即每年人口以相同比例增长。目前这一数值约为1.9%。这听起来可能不是很多,但它意味着,每四十年世界人口就会翻一番。2022年,我将庆祝自己80岁的生日,而在我人生的这段历程中,世界人口比我出生时膨胀了四倍。这样的指数增长不能持续到下个千年。到2600年,世界将拥挤得“摩肩擦踵”,电力消耗将让地球变成“炽热”的火球。这是岌岌可危的。然而我是个乐观主义者,我相信我们可以避免这样的世界末日,而最好的方法就是移民到太空,探索人类在其他星球上生活的可能。

而在2017年7月,霍金就痛批美国总统特朗普退出气候问题《巴黎协定》的决定,可能将导致不可逆转的气候变化,警告称此举或将让地球变成一个金星一样的温室星球。霍金在接受BBC专访时表示,我们正在接近全球变暖不可逆转的临界点,特朗普的决定可能将地球推过这个临界点,变成像金星一样的星球,温度高达250度,并且下着硫酸雨。

也是在2017年6月播放的纪录片《远征新地球》(ExpeditionNewEarth)中,霍金说,在未来一百年内,人类为生存必须离开地球,在太空寻求新家。

离开地球,霍金也不是光嘴皮子吓唬吓唬大家,2016年4月12日在纽约宣布启动“突破射星”计划,将同俄罗斯商人尤里·米尔纳(YuriMilner),以及美国社交网站面簿创始人兼总裁扎克伯格(MarkZuckerberg)合作建造能以五分之一光速飞往比邻星的微型星际飞船。

除了地球即将面临的各种风险,霍金更关切人类正在创造一个毁灭自己的怪物:人工智能(AI)。

2017年3月,霍金在接受英国《泰晤士报》采访时再次发出警告,“人类需要控制以人工智能为代表的新兴科技,以防止它们在未来可能对人类生存带来的毁灭性威胁。”他还说,“自从人类文明开始以来,侵略便一直存在,往往出现在相对具有生存能力优势的不同群体之间,而未来人工智能进一步发展便可能具备这种‘优势’”,霍金解释自己的警告时说道,“他们本身也是生根于达尔文的进化论之中。因此人类需要利用逻辑和理性去控制未来可能发生的威胁。”

2016年10月19日,剑桥大学“莱弗休姆的未来智能中心(LCFI)”正式投入使用。霍金在庆祝典礼上发表了演讲。霍金在演讲中批评了人工智能的无节制发展,他认为,人工智能技术的确有希望带来巨大的福利,比如根除疾病和贫困,但是它同样也可能带来危险,比如强大的自主式武器,或者帮助少数人压迫多数人。“我们花了大量的时间来学习历史。”霍金说,“让我们面对现实,大部分的历史是愚蠢的。所以对于那些学习未来智能的人应该表示欢迎。”“我们生活的每一个方面都会改变。总之,创造AI的成功可能是我们文明历史上最大的事件。”霍金说。

2016年1月26日和2月2日在BBC电台第四频道播出霍金瑞思系列演讲(ReithLectures),在演讲中他直言,科学技术的进一步发展会惹出更多的新麻烦。同样在这个演讲中,霍金依旧认为科技进步是人类的新威胁。他甚至提及若人类最终得以在其他星球建立家园,或许还能幸存下来。

“尽管地球在某一年遭受灭顶之灾的可能性很低,但随着时间的推移,在未来几千或几万年,这会是可以预见的事情。那时,我们应该已经进入太空、住到其他星球上。所以地球上的毁灭并不意味着人类的终结。”“然而,至少在未来数百年里我们还无法在太空世界建起人类的地盘。所以我们现在必须非常小心。”

2015年,霍金曾联合思想家乔姆斯基马斯克等数千名知识分子发表联名公开信中警告:必须取缔“机器人杀手”的研发和应用,人工智能方面的军备竞赛可能是人类的灾难,它将助长战争和恐怖主义,加剧世界动荡局势。